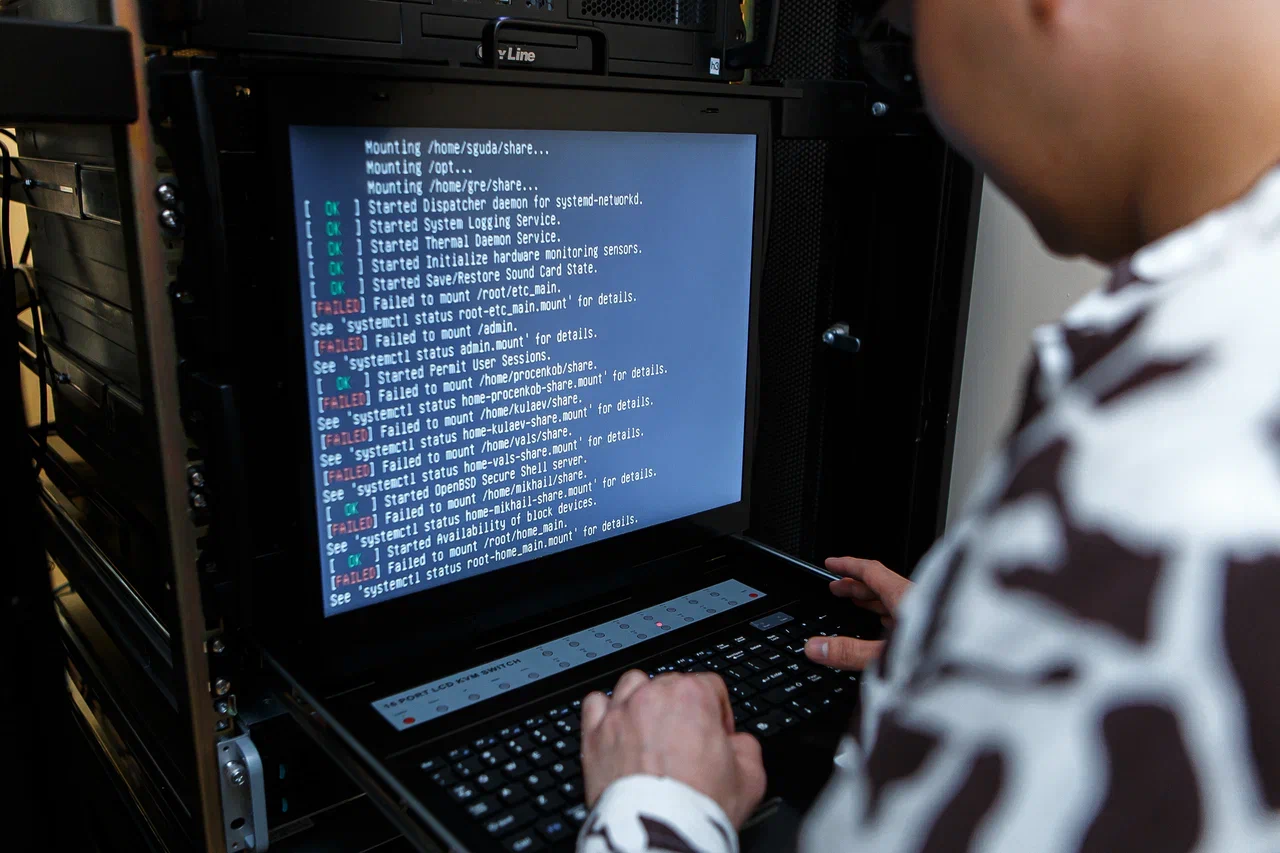

Атака отравления данных (data poisoning) — это реальная угроза для систем машинного обучения: злоумышленник незаметно внедряет в обучающие данные искажённые примеры, и точность модели может упасть, например, с 95% до 40%. Особенно коварны такие атаки на последовательных данных (логи сети, транзакции, показания датчиков): вред наносится постепенно, растянуто во времени, а внешне модель продолжает работать корректно. Классические алгоритмы либо пропускают угрозу, либо требуют огромных ресурсов для защиты.

Исследователи НИЯУ МИФИ (Москва) разработали архитектуру MambaShield на базе селективных моделей пространства состояний (sSSM). В отличие от обычных моделей, которые пытаются обработать все звуки сразу (как в шумном кафе), MambaShield фокусируется только на релевантной информации, динамически решая, что сохранить из прошлого контекста, а что отбросить — это позволяет эффективно отфильтровывать отравленные образцы.

В основе системы — три объединённые технологии. Первая: прогрессивная дистилляция устойчивости (PARD), где несколько моделей-«учителей» специализируются на разных типах атак (подмена меток, скрытые закладки, градиентные атаки), а затем компактный «ученик» перенимает их знания, работая быстро и надёжно. Вторая: иерархическое обучение с подкреплением (HRL) — система сама адаптирует стратегию защиты в реальном времени, если атака становится хитрее, без участия человека. Третья: PAC-Bayesian сертификация, которая даёт математические гарантии устойчивости: теоретически доказано, что даже при отравлении 30% обучающих данных точность останется выше 97%. Эксперименты на крупных наборах данных о кибератаках (CIC-IoT-2023, CSE-CICIDS2018, UNSW-NB15) показали впечатляющие результаты: точность обнаружения MambaShield достигла 99,1% (у лучших аналогов — около 97%).

В условиях атаки точность падает всего на 2–3%, тогда как обычные модели деградируют на 18–20%. По скорости архитектура обрабатывает последовательности в 4,2 раза быстрее классического Трансформера благодаря линейной сложности алгоритма. Однако есть и недостатки: система прекрасно работает на отрезках до 1000 шагов, но при длине последовательности более 5000 шагов накапливаются ошибки округления, и точность может снизиться.

Кроме того, если доля отравленных примеров в данных превышает 50–70%, любая система, включая MambaShield, начинает ошибаться. Тем не менее, разработка применима во многих областях: в здравоохранении — для защиты от намеренных искажений медицинских данных; в беспилотном транспорте — для повышения устойчивости к отравлению датасетов дорожных знаков; в финансах — для выявления скрытых аномалий, когда злоумышленники долгое время совершают «безопасные» транзакции, а затем проводят кражу; и в промышленности — например, для защиты систем предиктивной аналитики турбин на электростанциях, чтобы атакующий не мог подмешивать искажённые значения с датчиков и отключать сигналы тревоги.

Работа, опубликованная в журнале Expert Systems with Applications, уже получила грант от Министерства экономического развития РФ в рамках программы развития центров искусственного интеллекта.

«MambaShield — это не просто очередной алгоритм, — пишут исследователи. — Это фундамент для доверенного ИИ, который можно устанавливать на атомные станции, в финансовые и медицинские организации, не боясь, что злоумышленник "отравит" обучающую выборку одной хитрой картинкой или пакетом данных».

Источник: Минобрнауки России